研究展示

データと学習の科学

04

深層学習のボトルネック解消で精度を向上

~深層学習における、より高い表現能力を持つ出力関数~

どんな研究

深層学習による画像認識や機械翻訳において予測精度を改良するための研究です。深層学習は大量のデータをモデルが学習することで、例えば画像が入力されたときにそれが動物、車、人であるという確率を出力します。モデルの最後に使用する出力関数を改良して高精度化します。

どこが凄い

高精度なモデルを構築するためには、様々な確率のパターンを出力できる表現力が必要となります。既存の出力関数は表現力のボトルネックとなり、精度向上に大量のパラメータを必要とするため、計算コストが高くなります。そこで私達はパラメータを増やすことなく表現力を改善する技術を作りました。

めざす未来

本技術を用いることで、高精度なモデルを既存のモデルの一箇所を変更するだけで構築できるようになります。本研究のように表現力のボトルネックを解消していくことで、より少ないパラメータ数、計算コストで高精度な予測が可能な深層学習モデルの実現に寄与します。

関連文献

- [1] S. Kanai, Y. Fujiwara, Y. Yamanaka, S. Adachi, “Sigsoftmax: Reanalysis of the softmax bottleneck,” in Proc. 32nd Conference on Neural Information Processing Systems (NeurIPS), 2018.

ポスター

PDFの表示にはAdobe Acrobat Reader等のPDF閲覧表示が必要です。

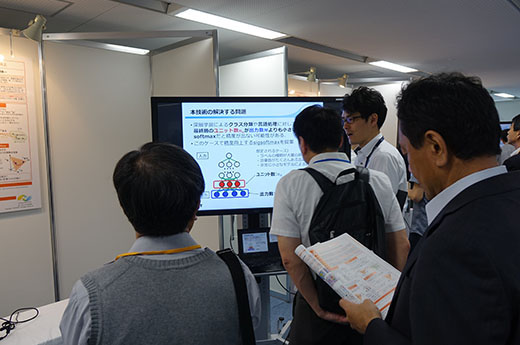

当日の様子

連絡先

金井 関利(Sekitoshi Kanai) ソフトウェアイノベーションセンタ

Email:

Email: