研究展示

メディアの科学

20

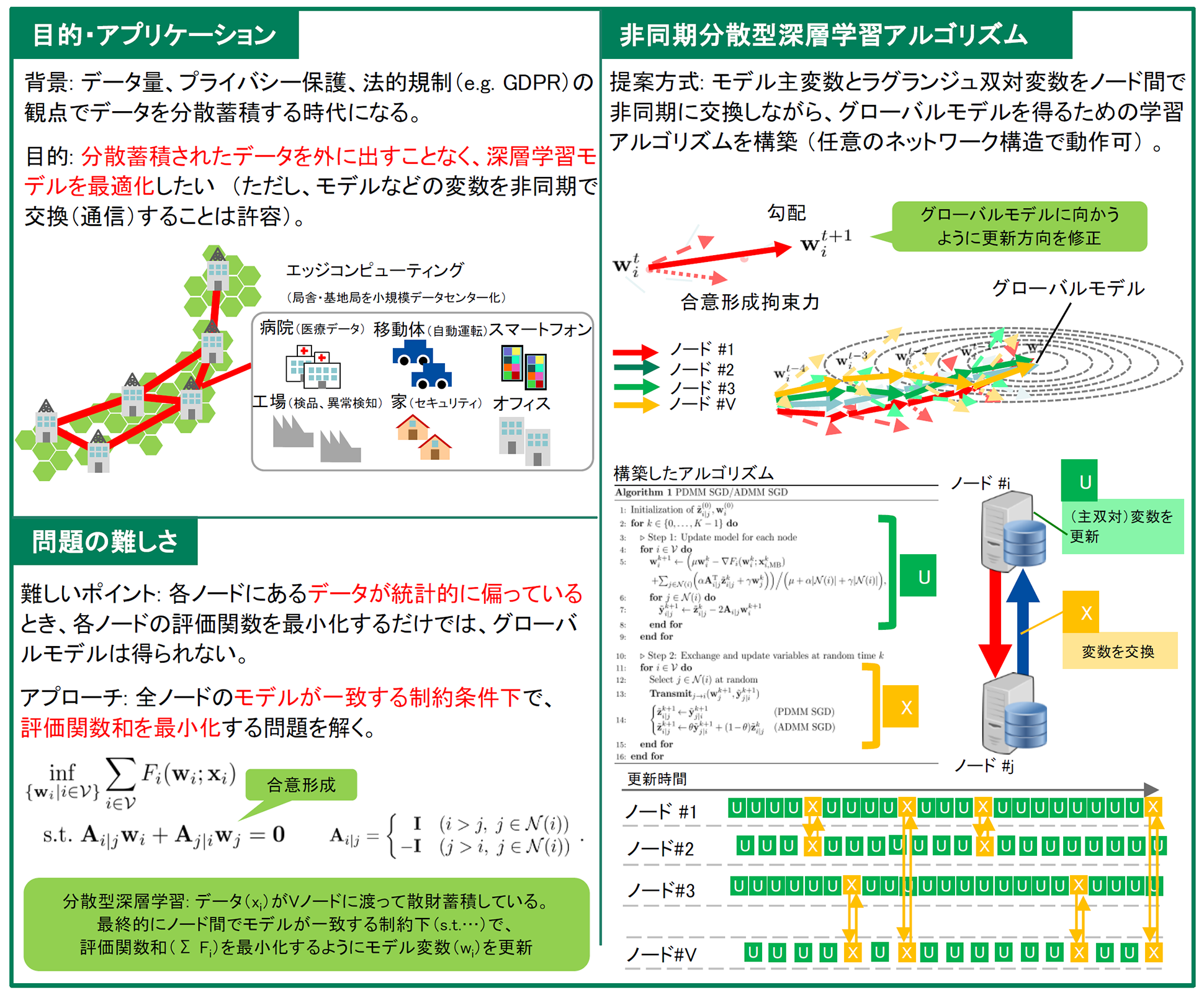

データを端末から漏洩させない分散深層学習

分散NW上で機械学習をするための非同期合意形成技術

どんな研究

現在の深層学習では、1か所に集約したデータを使ってモデルを学習することが一般的です。しかし、データ量の激増やプライバシー保護の観点から、近い将来データは分散蓄積されるようになるでしょう。多端末に分散蓄積されたデータを外に出すことなく、機械学習モデルを最適化する手法を提案します。

どこが凄い

多端末に蓄積されたデータは、統計的に偏っていると仮定することが自然です(例:各端末には一部クラスのデータしか存在しない)。その状況で、端末同士がモデル等の変数を非同期に交換(通信)しながら、全データを使って獲得したかのようなグローバルモデルを学習するアルゴリズムを開発しました。

めざす未来

現在は、一部のアプリケーションプラットフォームがデータを集約/独占することにより、高度なサービスを提供しています。データの所有権を個人に帰属させ、プライバシーを保護しながら、多様なサービスに利用できる社会をめざしています。

関連文献

- T. Sherson, R. Heusdens, B. Kleijn, “Derivation and analysis of the primal-dual method of multipliers based on monotone operator theory,” IEEE transactions on signal and information processing over networks, Vol. 5, 2, pp. 334-347, 2018.

- K. Niwa, N. Harada, G. Zhang, B. Kleijn, “Edge-consensus learning: deep learning on P2P networks with nonhomogeneous data,” submitted to KDD 2020

ポスター

展示説明ムービー

動画の公開は終了いたしました。ご了承くださいますようお願いいたします。

連絡先

丹羽 健太 (Kenta Niwa) コミュニケーション科学基礎研究所/メディアインテリジェンス研究所

Email:

Email: